Материалы по тегу: microsoft azure

|

25.10.2023 [14:40], Руслан Авдеев

Microsoft потратит $3,2 млрд на развитие ЦОД для облачной и ИИ-инфраструктуры в АвстралииКомпания Microsoft намерена осуществить крупнейшее за 40 лет для своих программ в Австралии вложение. Как сообщает Bloomberg, компания намерена в течение двух лет потратить $3,2 млрд на расширение сети ЦОД для облачных вычислений и реализации ИИ-проектов. Новые инвестиции помогут Microsoft обеспечить рост количества ЦОД в Канберре, Сиднее и Мельбурне на почти в полтора раза — с 20 до 29 дата-центров. Дополнительно в штате Новый Южный Уэльс будет открыт образовательный центр Microsoft Datacenter Academy. Также предусмотрено сотрудничество со спецслужбами страны по вопросам обеспечения кибербезопасности. Объявление о новых инвестициях состоялось через день посоле того, как премьер-министр Австралии Энтони Альбанезе (Anthony Albanese) прилетел в США с четырёхдневным официальным визитом, в рамках которого предусмотрена и встреча с президентом США Джо Байденом (Joe Biden). Ожидается, что основной темой обсуждений станут поставки критически важных полезных ископаемых и технические инновации.

Источник изображения: Joey Csunyo/unsplash.com В рамках второго этапа соглашения AUKUS, подписанного в 2021 году, страны договорились о более тесном технологическом сотрудничестве — США, Великобритания и Австралия будут делиться критически важными сведениями, включая данные о квантовых вычислениях и искусственном интеллекте. Впрочем, в своём стремлении развивать ЦОД в Австралии Microsoft далеко не одинока и даже не является рекордсменом. Ещё весной 2023 года появилась информация, что AWS к 2027 году вложит $8,9 млрд в свои дата-центры на территории страны.

25.10.2023 [11:50], Сергей Карасёв

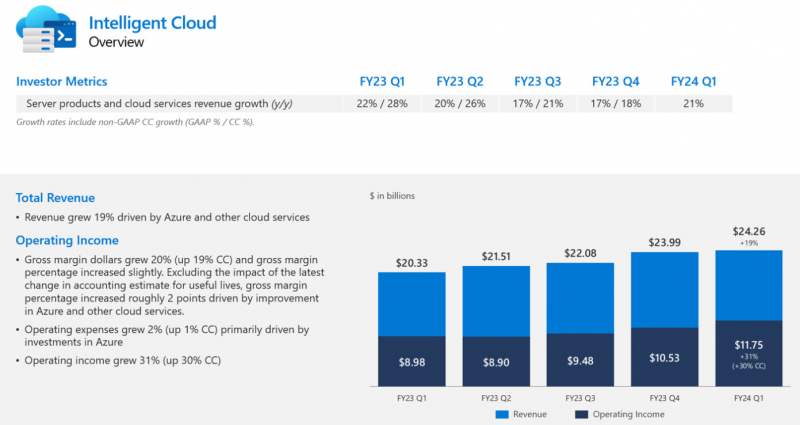

Квартальная выручка облачного подразделения Microsoft выросла почти на 20 %, превысив $24 млрдКорпорация Microsoft отрапортовала о работе в I четверти 2024 финансового года, которая была закрыта 30 сентября. Общая выручка редмондского гиганта достигла $56,5 млрд, что примерно на 13 % больше прошлогоднего результата, составлявшего около $50,1 млрд. Квартальная операционная прибыль в годовом исчислении увеличилась на 25 % — с $21,5 млрд до $26,9 млрд, тогда как чистая прибыль поднялась на 27 % — с $17,6 млрд до $22,3 млрд. Прибыль в пересчёте на одну ценную бумагу оказалась на уровне $2,99 против $2,35 годом ранее (плюс 27 %). Microsoft продолжает активно развивать облачное направление. В подразделении Intelligent Cloud, которое, помимо облачных сервисов, включает Enterprise Services, Windows Server и SQL Server, выручка по итогам I квартала 2024 финансового года достигла $24,3 млрд. Это на 19 % больше результата за аналогичный период предыдущего финансового года, когда показатель равнялся $20,3 млрд. Денежные поступления от серверных продуктов и облачных услуг поднялись на 21 % год к году благодаря росту доходов от Azure и других сервисов на 29 %. По направлению Productivity and Business Processes (офисные приложения Office и Office 365, Dynamics CRM) выручка за трёхмесячный период достигла $18,6 млрд против $16,5 млрд годом ранее (прибавка на уровне 13 %). Выручка от коммерческих продуктов Office и облачных сервисов поднялась на 15 % благодаря росту денежных потоков от Office 365 на 18 %. Выручка от потребительских продуктов Office и облачных сервисов показала прибавку в 3 %, а число подписчиков Microsoft 365 Consumer достигло 76,7 млн.

21.07.2023 [23:10], Алексей Степин

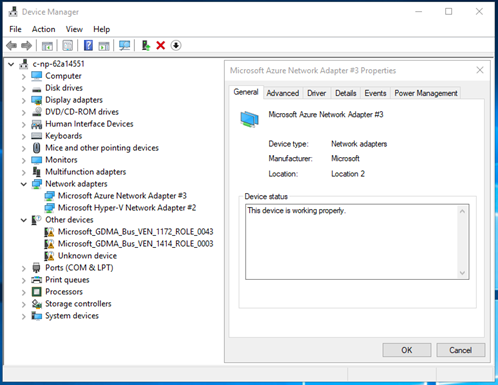

Microsoft предлагает протестировать DPU MANA с Azure BoostКрупные облачные провайдеры давно осознали пользу, которую могут принести DPU и активно применяют подобного рода решения. В частности, AWS давно использует платформу Nitro, Google разработала DPU при поддержке Intel, а Microsoft активно готовит к запуску собственную платформу под названием MANA. Основой MANA является кастомный чип SoC, разработанный специально с учётом обеспечения высокой пропускной способности, стабильности подключения и низкой латентности. DPU на его основе обеспечивает пропускную способность до 200 Гбит/с, а также поддерживает подключение удалённого хранилища данных на скоростях до 10 Гбайт/с при производительности до 400 тыс. IOPS. Отметим, что ранее AMD заявила о появлении DPU Pensando в облаке Azure, а сама Microsoft в прошлом году поглотила разработчика DPU Fungible.

Изображение: Microsoft MANA является частью услуги Azure Boost и берёт на себя управление всеми аспектами виртуализации, включая работу с сетью и данными, а также функции управления хост-системой. Перенос этих функций на отдельную платформу не просто улучшает производительность и масштабируемость, но и обеспечивает дополнительный слой безопасности. MANA уже задействованы в инфраструктуре Azure и подтвердили высочайшую скорость при работе с внешними хранилищами данных для инстансов Ebsv5, а также отличную пропускную способность и низкую латентность сетевого канала для всех инстансов семейств Ev5 и Dv5. MANA поддерживает Windows и Linux, а для более тонкой работы с аппаратной частью ускорителя можно задействовать DPDK. В части информационной безопасности следует отметить наличие криптоядра, соответствующего стандартам FIPS 140. В настоящее время сервис Azure Boost доступен в качестве превью. Компания приглашает к сотрудничеству партнёров и клиентов с высокими запросами к характеристикам сетевого канала и хранилищ.

01.06.2022 [01:18], Владимир Мироненко

Ведущий специалист NERSC перешёл в Microsoft, заявив, что строящиеся экзафлопсные суперкомпьютеры будут последними в своём родеГленн Локвуд (Glenn K. Lockwood), ведущий специалист Национального научного вычислительного центра энергетических исследований (NERSC) при Министерстве энергетики США перешёл на работу в Microsoft. Он является архитектором высокопроизводительных масштабируемых систем хранения данных для суперкомпьютеров. Локвуд, в частности, руководил развёртыванием первого в мире 35-Пбайт All-Flash хранилища с ФС Lustre для суперкомпьютера Perlmutter. В своём блоге Локвуд объяснил, почему он ушёл из NERSC в Microsoft. По его словам, лидирующие HPC-системы балансируют на грани выживания, в то время как HPC-системы среднего клсса практически полностью обесцениваются поставщиками облачных услуг. При текущих тенденциях стоимость строительства нового дата-центра и обширной инфраструктуры питания и охлаждения для каждого нового мощного суперкомпьютера очень скоро станет непомерно высокой, говорит Локвуд. Он высказал мнение, что ЦОД мощностью 50–60 МВт, строящиеся сейчас для экзафлопсных суперкомпьютеров, будут последними в своём роде.

Источник изображения: AMD Что касается менее мощных систем, таких как Perlmutter, то необходимость в них постепенно сокращается по мере того, как облако набирает обороты. «Вы можете установить полную систему [HPE] Cray EX, идентичную той, что вы можете найти в NERSC или OLCF, в Azure <…> и интегрировать её с богатыми инфраструктурными возможностями облака», — говорит Локвуд. Кроме того, облака действительно гораздо быстрее внедряют новинки. Так, процессоры AMD EPYC MilanX и ускорители Instinct MI200 появились в инфраструктуре Microsoft Azure намного раньше, чем в HPC-центрах. «Я не утверждаю, что знаю будущее, и многое из того, что я изложил, является в лучшем случае гипотетическим», — заявил Гленн Локвуд, отметив, что приверженность Министерства энергетики США к независимым HPC-системам сохранится по меньшей мере ещё десятилетие. Локвуд стал очередным специалистом, покинувшем традиционный HPC-сектор и ушедшим в Microsoft. В 2020 году в Microsoft перешёл технический директор Cray Стив Скотт (Steve Scott). Год спустя к Microsoft присоединился соруководитель программы Cray PathForward доктор Дэн Эрнст (Dan Ernst).

14.11.2021 [21:11], Владимир Мироненко

LiquidStack и Microsoft продемонстрировали ИИ-серверы с двухфазным иммерсионным охлаждениемLiquidStack, дочернее предприятие BitFury, специализирующееся на разработке иммерсионных СЖО, и Microsoft продемонстрировали на OCP Global Summit стандартизированное решение с двухфазным погружным жидкостным охлаждением. Демо-серверы Wiwynn, разработанные в соответствии со спецификациями OCP Open Accelerator Infrastructure (OAI), были погружены в бак LiquidStack DataTank 4U, способный отводить порядка 3 кВт/1U (эквивалент 126 кВт на стойку). LiquidStack сообщила, что она впервые оптимизировала серверы OCP OAI для охлаждения путем погружения в жидкость. По словам компании, её двухфазные иммерсионные СЖО DataTank предоставляют наиболее эффективное решение, которое требует немного пространства и потребляет меньше энергии, чем другие системы охлаждения, и вместе с тем повышает плотность размещения компонентов и их производительность.

Фото: LiquidStack В демо-серверах использовались ИИ-ускорители Intel Habana Gaudi, погружённые в жидкий диэлектрик (от 3M) с низкой температурой кипения, который наиболее эффективно отводит тепло благодаря фазовому переходу. Данное решение должно помочь достижению показателя PUE в пределах от 1,02 до 1,03, поскольку оно практически не потребляет энергию. LiquidStack утверждает, что у её СЖО эффективность теплоотвода примерно в 16 раз выше, чем у типичных систем воздушного охлаждения. По мнению компании, системы высокопроизводительных вычислений (HPC) уже сейчас слишком энергоёмки, чтобы их можно было охлаждать воздухом. Поэтому следует использовать платы, специально предназначенные для жидкостного охлаждения, а не пытаться адаптировать те, что были созданы с расчётом на воздушные системы — при использовании СЖО вычислительная инфраструктура может занимать на 60% меньше места.

Изображение: Microsoft LiquidStack и Wiwynn являются партнёрами. В апреле Wiwynn инвестировала в LiquidStack $10 млн. Также Wiwynn протестировала серверы с погружным жидкостным охлаждением в центре обработки данных Microsoft Azure в Куинси (штат Вашингтон). Microsoft, как и другие гиперскейлеры, уже некоторое время изучает возможности иммерсионных СЖО.

01.03.2021 [15:09], Сергей Карасёв

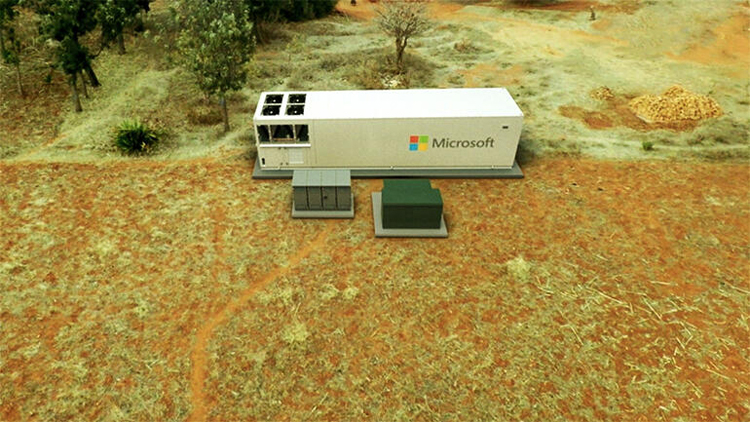

Microsoft Azure MDC: мобильное облако в 40-футовом контейнереКорпорация Microsoft начала поставки любопытного серверного решения — центра обработки данных Azure Modular Data Center (MDC), все составляющие которого заключены в стандартный 40-футовый контейнер. Такое исполнение позволяет перевозить систему на различных видах транспорта и быстро вводить в эксплуатацию. ЦОД может быть развёрнут в любом месте, где есть подходящая площадка для установки контейнера и электрическая сеть необходимой мощности. Более того, питание может подаваться от дизельных генераторов. ЦОД и всё его оборудование сконструированы так, чтобы пережить и транспортировку, и эксплуатацию в не самых благоприятных условиях.  Система позволяет получить доступ к вычислительным мощностям облака Azure. Контейнерный ЦОД может функционировать в суровом климате, обеспечивая бесперебойную работу критически важной инфраструктуры. Платформа MDC может использоваться, к примеру, в центрах гуманитарной помощи, передвижных пунктах управления, а также на территориях предприятий добывающей промышленности. MDC может работать как полностью автономно, так и в связке с «большим» облаком Azure. Причём предусмотрена возможность использования спутниковых средств связи — на случай перебоев в основном интернет-канале. Собственно говоря, именно в рамках совместного со SpaceX проекта Azure Space и были анонсированы эти ЦОД.  Внутри контейнера размещены три серверных блока, каждый из которых содержит две стойки 42U с коммутаторами и контроллерами. На каждый блок приходится 8 серверов и 48 узлов хранения. Все они работают под управлением Azure Stack Hub. Доступ к такому ЦОД предоставляется на условиях аренды, как и в случае более простых и компактных устройств серии Azure Stack Edge.

15.09.2020 [19:33], Алексей Степин

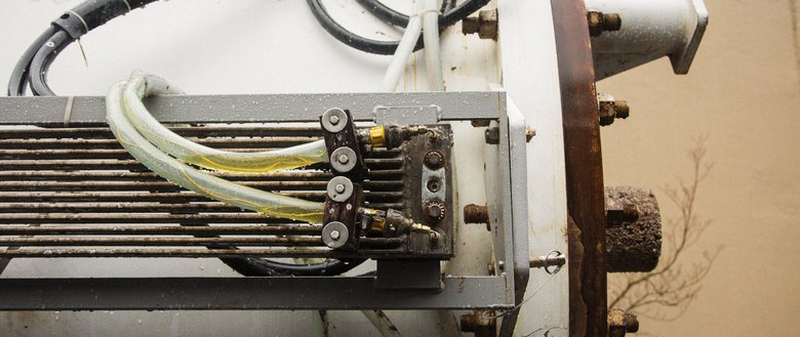

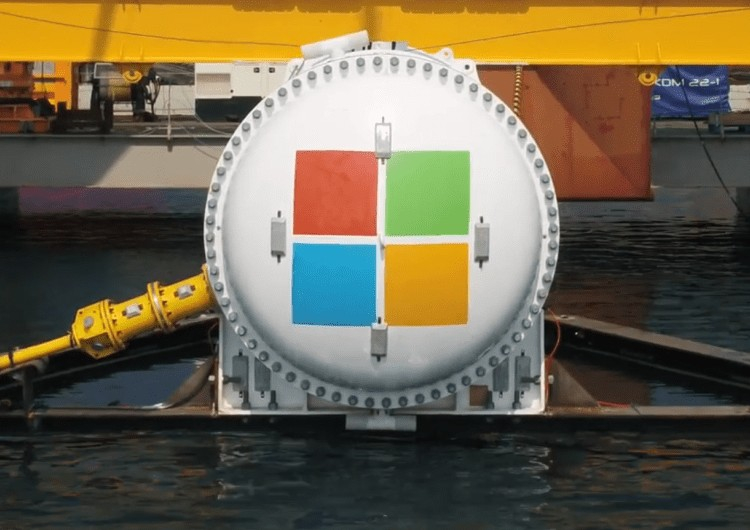

Microsoft Natick может стать будущим периферийных ЦОД, надёжность доказанаЛюбой современный ЦОД — это не только помещение, занимающее определённую площадь, но ещё и серьёзные системы питания и, особенно, охлаждения. Ряд компаний считает, что с точки зрения последнего фактора имеет смысл рассмотреть возможность размещения ЦОД под водой, на дне моря, где температура постоянна и достаточно низка. В их числе Microsoft со своей разработкой Project Natick. Первый прототип Natick, доказавший работоспособность концепции, успешно проработал 105 дней в водах Калифорнийского залива, однако действительно серьёзная мощность была достигнута лишь во второй фазе, о которой и идёт речь в данной заметке. Второй прототип Natick являет собой 12,2-метровый цилиндрический контейнер стандарта ISO 40, внутри размещено 12 стоек с 864 серверами Microsoft (в составе присутствуют ПЛИС-ускорители) и СХД общим объёмом 27,6 Пбайт. Система охлаждения во втором варианте была разработана французской группой Naval Group на основе теплообменников, использующихся в современных подводных лодках.  На этот раз местом размещения подводного ЦОД был выбран район Оркнейских островов в 193 километрах (120 миль) от берега, глубина погружения составляла примерно 35 метров. Для питания и данных использовался общий кабель, содержащий как силовые линии, способные передать около четверти мегаватта, так и оптические волокна. Проект создавался с прицелом на пятилетний срок работы без обслуживания, с прицелом на 20 лет в будущем. Для обеспечения повышенной надёжности внутреннее пространство контейнера заполнено азотом, который практически инертен и способствует уменьшению износа оборудования.  14 сентября Microsoft сообщила об окончании второй фазы Project Natick, которая продлилась два года. Сам контейнер был извлечён из моря ещё летом, и специалисты и эксперты занялись изучением состояния аппаратного обеспечения, входившего в состав второго прототипа автономного ЦОД. Результат проекта признан очень успешным, возглавляющий Project Natick Бен Катлер (Ben Cutler) заявил, что «дело сделано, и второй вариант Natick можно с полным правом назвать подходящим строительным блоком». Согласно статистике, около 50% населения планеты проживает недалеко от берега моря, поэтому размещение подводных ЦОД в прибрежных областях вполне оправдано, а Европейский центр морской энергетики (Europetn Marine Energy Centre) вообще говорит о возможности использования для питания таких ЦОД приливных турбин и волновых конвертеров, что сделает их практически автономными, не считая оптоволоконного подключения.

Часть системы охлаждения Natick Тонкости функционирования Natick ещё предстоит изучить, но предварительные результаты оказались несколько обескураживающими: ЦОД в герметичном контейнере, покоившийся на дне моря, и, естественно, лишённый обслуживания, оказался в восемь раз надёжнее, нежели его копия, расположенная на суше. Причины примерно ясны: стабильные температуры, отсутствие окисляющей атмосферной среды, а также каких-либо серьёзных вибраций. Компания считает, что эти данные могут помочь и в проектировании более надёжных наземных ЦОД.  Microsoft признала, что проект всё ещё далёк от завершения, но считает, что стандартный ЦОД Azure в подводном варианте уже может быть создан. Вице-президент отдела Azure по системам класса mission critical Вильям Чэппел (William Chappell) отметил, что его команда особенно заинтересована в пост-квантовых методах шифрования, критичных для такого рода периферийных центров обработки данных. Также заявлено, что Natick успешно может служить в качестве периферийного ЦОД или ЦОД с повышенной безопасностью; последнее достаточно очевидно — получить доступ к оборудованию, находящемуся под водой, намного сложнее, нежели в обычном ЦОД. Надёжнее в этом плане может быть только сервер на орбите, но по понятным причинам такое решение намного дороже и сложнее, нежели Natick, оно менее мощное, а также не гарантирует постоянной низкой латентности, которая может быть критичной в edge-сценариях использования.

28.07.2020 [11:38], Юрий Поздеев

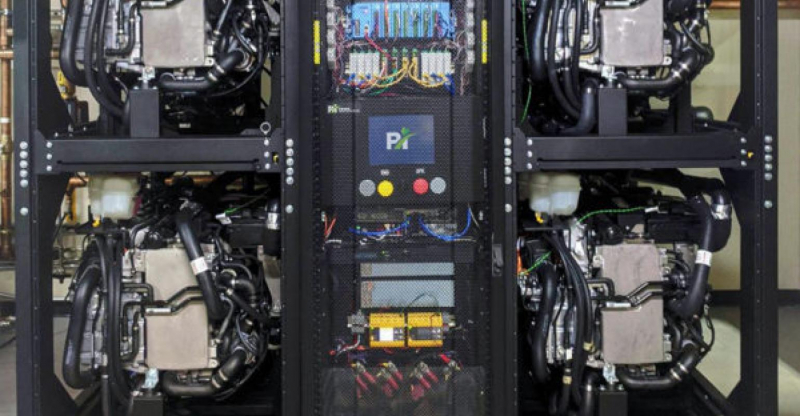

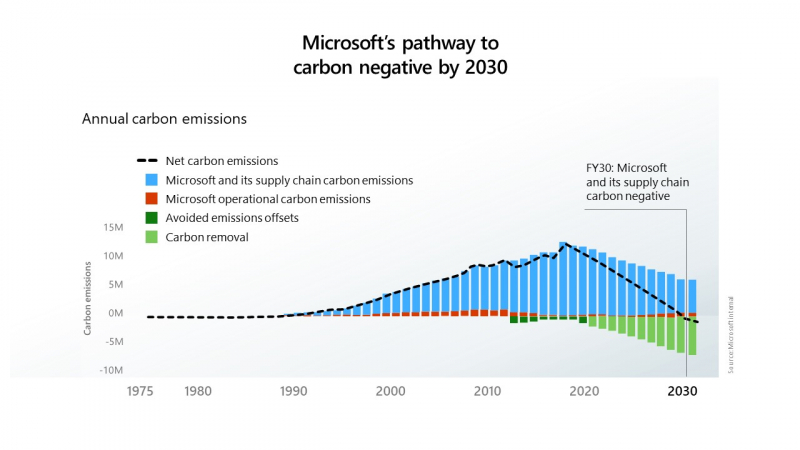

Водород вместо дизеля: Microsoft Azure получит новые источники резервного питанияMicrosoft сообщила, что успешно протестировала использование водородных топливных элементов для резервного питания своих серверов в центрах обработки данных. Это первый шаг к внедрению новых технологий, исключающих использование дизельного топлива в системах аварийного питания. Водород хранился в резервуарах на трейлерах, припаркованных возле лаборатории в Солт-Лейк-Сити, штат Юта. Такой вариант хранения водорода был продемонстрирован в ходе эксперимента, но в дальнейшем планируется использовать стационарные резервуары. Microsoft намерена прекратить использование дизельного топлива к 2030 году в рамках своих инициатив по снижению вредных выбросов.  В эксперименте использовалась нагрузка в виде 10 стоек облачных серверов Microsoft Azure: в течение 48 часов использовалась 250-КВт система на топливных элементах. Такое время работы от топливных элементов выбрано не случайно, поскольку большинство перебоев в подаче электроэнергии длятся менее 48 часов.  Ранее для подобной задачи использовались шесть дизель-генераторов. Следующим шагом Microsoft планирует испытать систему резервного питания на топливных элементах мощностью 3 МВт, чтобы продемонстрировать как масштабируется система для больших дата-центров.  Дизельные генераторы на данный момент являются оптимальным выбором для большинства ЦОД, однако Microsoft стремится к сокращению выбросов углекислого газа и хочет полностью отказаться от дизельного топлива к 2030 году. Цель амбициозная, но достижимая. Пока основным препятствием к ее осуществлению является цена. Водород сам по себе до сих пор остается дорогим топливом, а его транспортировка и хранения обходятся еще дороже. Следует также учесть, что водород более взрывоопасен, чем дизельное топливо, поэтому его хранение может стать большой проблемой для дата-центров, расположенных в крупных городах. Кроме радикальных мер по переводу аварийного питания дата-центров на водород, Microsoft рассматривает и более реальные альтернативы в виде питания генераторов от природного газа, который дает намного меньше выбросов, по сравнению с дизельным топливом, также рассматривается синтетическое дизельное топливо, которое при сгорании выделяет меньше углерода. Проектами по созданию более экологичных источников питания занимаются и другие компании: Rolls-Royce и Daimler Truck AG разработают топливные элементы для ЦОД, а Keppel и Mitsubishi намереваются создать водородную электростанцию. Ещё одной альтернативой могут стать ёмкие аккумуляторы — оператор Switch для своего дата-центра в Неваде построит комплекс из солнечной электростанции мощностью 127 МВт и модулей Tesla MegaPack суммарной ёмкостью 240 МВт∙ч

13.07.2020 [13:58], Юрий Поздеев

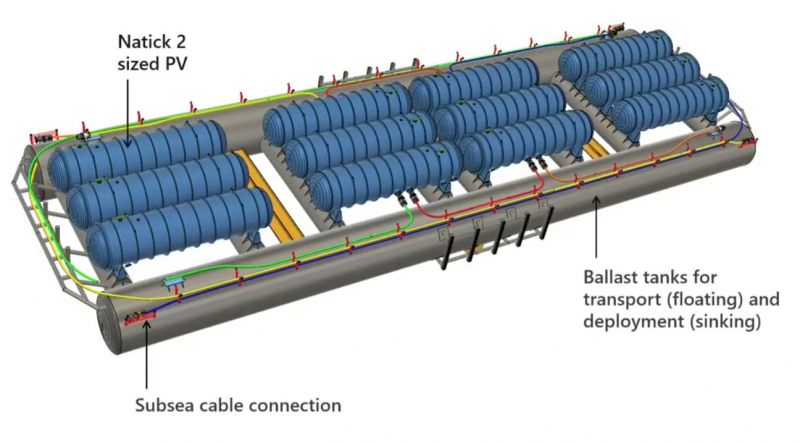

Microsoft продемонстрировала Natick 3 — подводный дата-центр третьего поколенияMicrosoft одновременно решает ряд инженерных задач с проектом Microsoft Azure Natick: снижает эксплуатационные расходы и обеспечивает меньшие задержки для дата-центров. Что же из себя представляет этот уникальный проект?  Начнем с истории: первый концепт Natick представлял собой стойку с серверами в стальной оболочке, которую опустили в океан, чтобы проверить работоспособность идеи. Попытка была удачной, Microsoft доказала, что можно использовать обычные серверы, развернутые в компактном корпусе на расстоянии 200 км в океане, что примерно давало задержку в 1 мс (2 мс в обе стороны). Видео с экспериментальным дата-центром Natick: Первая версия Natick была развернута у берегов Калифорнии и проработала 105 дней, что подтвердило жизнеспособность концепта. Два года спустя Microsoft Research погрузила под воду 14 стоек с серверами у побережья Шотландии. Этот регион был выбран не случайно: именно здесь используется множество возобновляемых источников энергии, что позволило сделать новый Natick еще более экологичным. Видео с демонстрацией Natick второго поколения: После более чем года работы Natick второго поколения Microsoft поделилась некоторыми данными: с точки зрения эффективности энергопотребления Natick демонстрирует коэффициент PUE в 1,07 — это очень мало для текущего производственного центра обработки данных. Низкий PUE означает снижение эксплуатационных расходов, а также делает Natick более экологичным. Обычный наземный дата-центр использует 4,8 литра воды на кВт/ч, при этом Natick не потребляет воду для работы, однако использует ее по-другому (споры с экологами по поводу нагрева океана и влияния на окружающую среду не закончились какими-то конструктивными выводами, по информации от самой Microsoft, влияние Natick на окружающую среду ничтожно мало). Этот аспект особенно актуален для стран, в которых существует дефицит воды и охлаждение дата-центров превращается в существенную проблему. Цилиндрический корпус Natick имеет вакуумную герметизацию, что означает, что серверы и ИТ оборудование избавлены от многих вредных факторов, таких как влажность и пыль. Кроме того, учитывая, насколько хорошо вода поглощает тепло и насколько велики океаны, можно утверждать, что на глубине 200 метров для дата-центра будет поддерживаться постоянная температура, без колебаний, свойственных наземным ЦОД (особенно это актуально для жарких регионов, где приходится использовать системы охлаждения с большим запасом). Natick 2 был рассчитан на эксплуатацию в течение пяти лет без технического обслуживания. Так что же Microsoft может предложить сегодня?  Natick третьего поколения представляет собой множество цилиндрических корпусов, закрепленных на большой стальной раме, в которой проложены коммутационные кабели и кабели питания. Общий размер составляет более 90 м (300 футов), с каждой стороны конструкции есть балластные цистерны для транспортировки и упрощения установки. Natick 3 состоит из 12 цилиндрических корпусов, общая мощность системы достигает 5 МВт, при необходимости могут быть построены и более крупные структуры, так как конструкция модульная и позволяет легко масштабировать мощность при необходимости. Microsoft не единственная компания, которая ведёт разработки в области подводных дата-центров, существуют еще разработки Nautilus Fata Technologies и более мелкие стартапы, однако они находятся только в самом начале пути и не имеют опыта промышленной эксплуатации дата-центров. Одно можно сказать точно: данное направление будет развиваться и в скором будущем мы увидим еще не одно подобное решение. |

|